2. I tre problemi studiati e i risultati

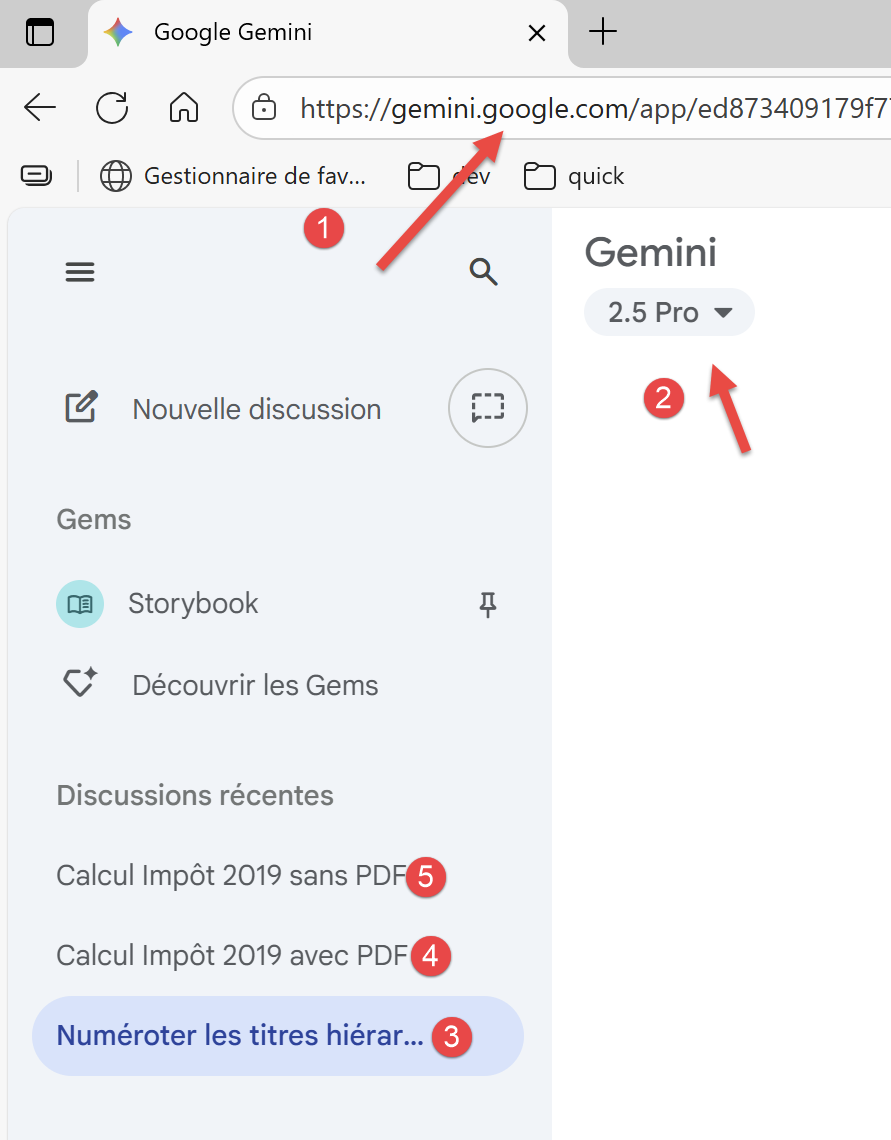

Chiederemo all'IA di studiare tre problemi, dal più semplice al più complesso. Diamo un'occhiata a uno screenshot di Google Gemini:

|

- In [1], l'URL di Gemini;

- In [2], la versione di Gemini utilizzata;

- In [3-5], i tre problemi sottoposti a Gemini;

2.1. Problema 1

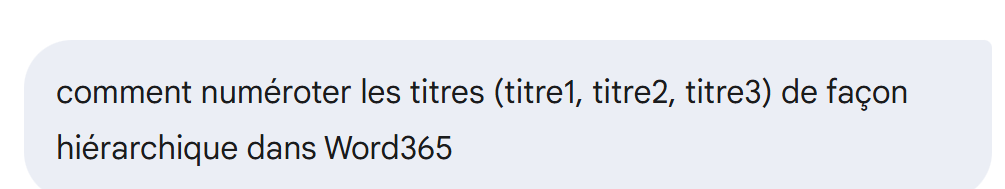

Il problema 1 è una semplice domanda:

|

Tutte le IA risponderanno correttamente a questa domanda.

2.2. Problema 2

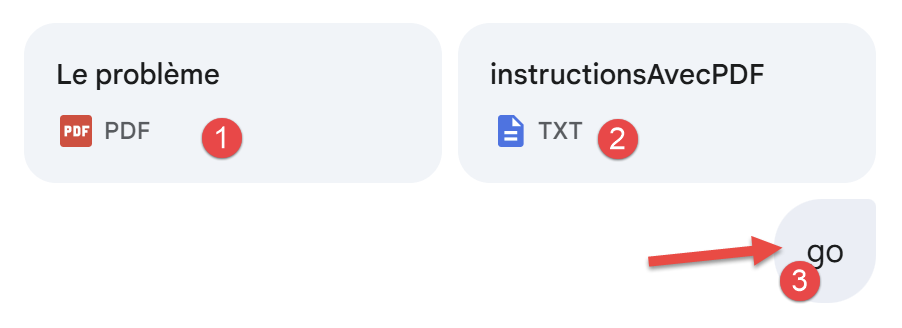

Il problema 2 è il seguente (screenshot da Gemini):

|

- In [1], il principio di calcolo delle imposte del 2019 sul reddito del 2018 è spiegato in un PDF. Torneremo su questo argomento;

- In [2], forniamo a Gemini istruzioni precise su ciò che vogliamo: uno script Python pulito che risolva il problema e convalidi la soluzione proposta con 11 test unitari;

- In [3], per eseguire Gemini, è necessario scrivere del codice;

Questo è esattamente lo stesso scenario di un compito di laboratorio universitario.

Le IA testate risolveranno il problema, ad eccezione di MistralAI e Perplexity.

2.3. Problema 3

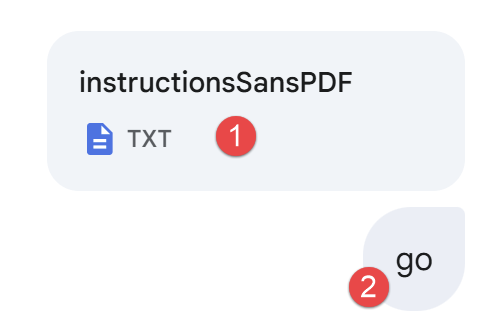

Utilizzando ancora uno screenshot di Google Gemini, il Problema 3 è il seguente:

|

- In [1], forniamo le nostre istruzioni, le stesse di prima. Ma poiché non forniamo il PDF contenente le regole di calcolo esatte, l'IA dovrà cercare queste regole online;

- In [3], avviamo l'IA;

Solo tre IA hanno superato questo test, in ordine di eccellenza (opinione strettamente personale, ovviamente):

- ChatGPT di OpenAI;

- Grok di xAI;

- Google Gemini;

L'IA ClaudeAI ha fallito nel problema 3. L'IA MistralAI ha fallito nei problemi 2 e 3, così come l'IA Perplexity. L'IA DeepSeek ha fallito nel problema 3.