2. Los tres problemas estudiados y los resultados

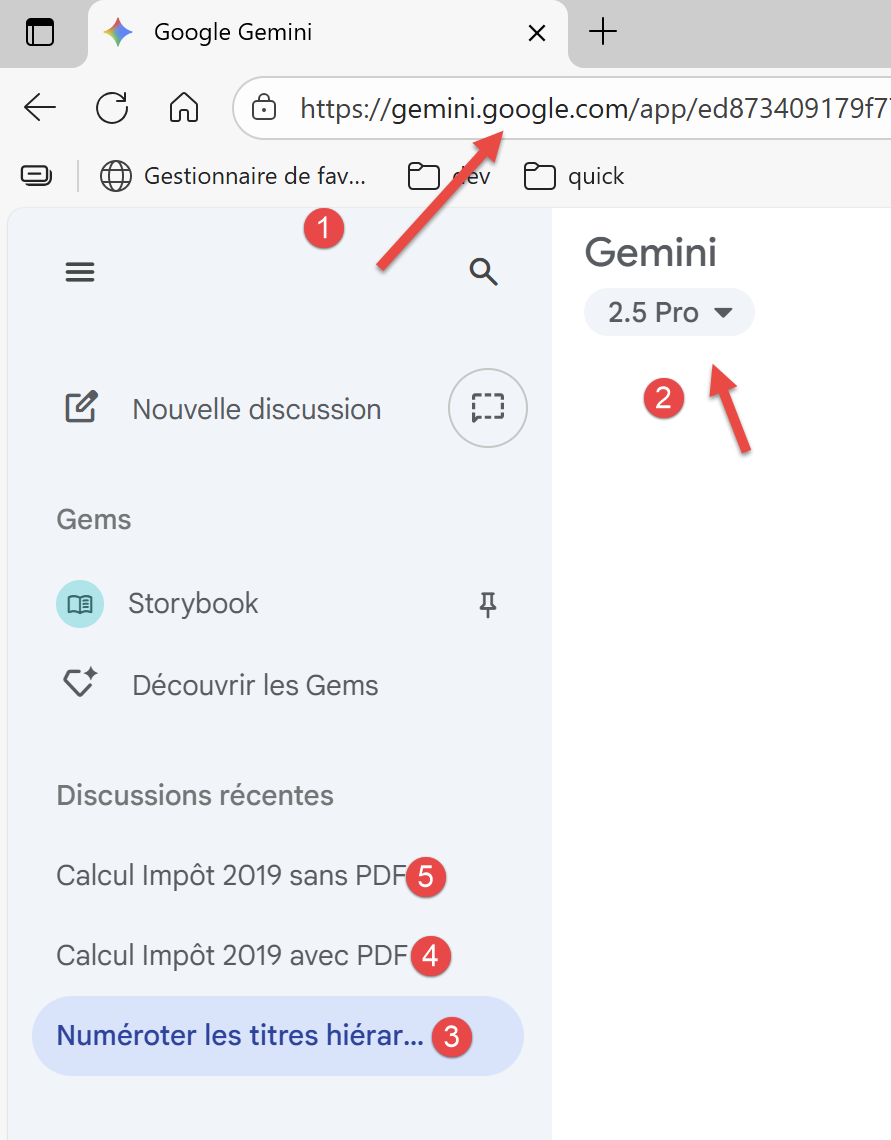

Le pediremos a la IA que estudie tres problemas, de lo más sencillo a lo más complejo. Veamos una captura de pantalla de Google Gemini:

|

- En [1], la URL de Gemini;

- En [2], la versión de Gemini utilizada;

- En [3-5], los tres problemas planteados a Gemini;

2.1. Problema 1

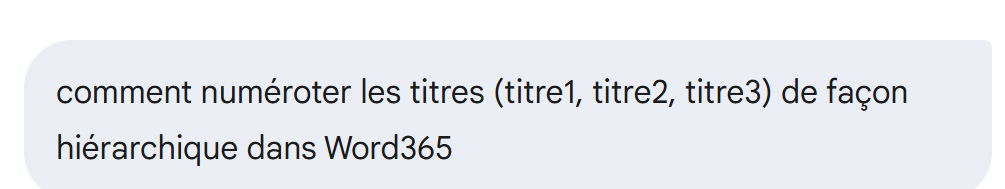

El problema 1 es una pregunta sencilla:

|

Todas las IA responderán correctamente a esta pregunta.

2.2. Problema 2

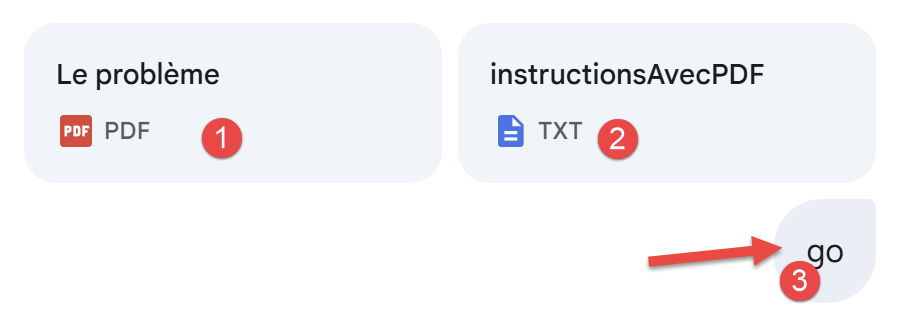

El problema 2 es el siguiente (captura de pantalla de Gemini):

|

- En [1], se explica en un PDF el principio de calcular los impuestos de 2019 sobre los ingresos de 2018. Volveremos sobre esto más adelante;

- En [2], le damos a Gemini instrucciones precisas sobre lo que queremos: un script de Python limpio que resuelva el problema y valide la solución propuesta con 11 pruebas unitarias;

- En [3], para ejecutar Gemini, hay que escribir algo de código;

Este es exactamente el mismo escenario que el de un trabajo de laboratorio universitario.

Las IA evaluadas resolverán el problema, con la excepción de MistralAI y Perplexity.

2.3. Problema 3

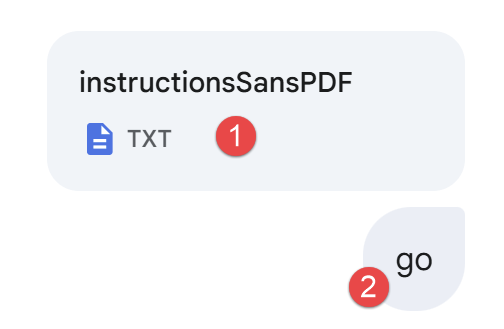

Siguiendo con una captura de pantalla de Google Gemini, el problema 3 es el siguiente:

|

- En [1], proporcionamos nuestras instrucciones, las mismas que antes. Pero como no proporcionamos el PDF que contiene las reglas de cálculo exactas, la IA tendrá que buscar estas reglas en Internet;

- En [3], ponemos en marcha la IA;

Solo tres IA superaron esta prueba, por orden de excelencia (opinión estrictamente personal, por supuesto):

- ChatGPT de OpenAI;

- Grok de xAI;

- Google Gemini;

La IA de ClaudeAI falló en el problema 3. La IA de MistralAI falló en los problemas 2 y 3, al igual que la IA de Perplexity. La IA de DeepSeek falló en el problema 3.