2. Os três problemas estudados e os resultados

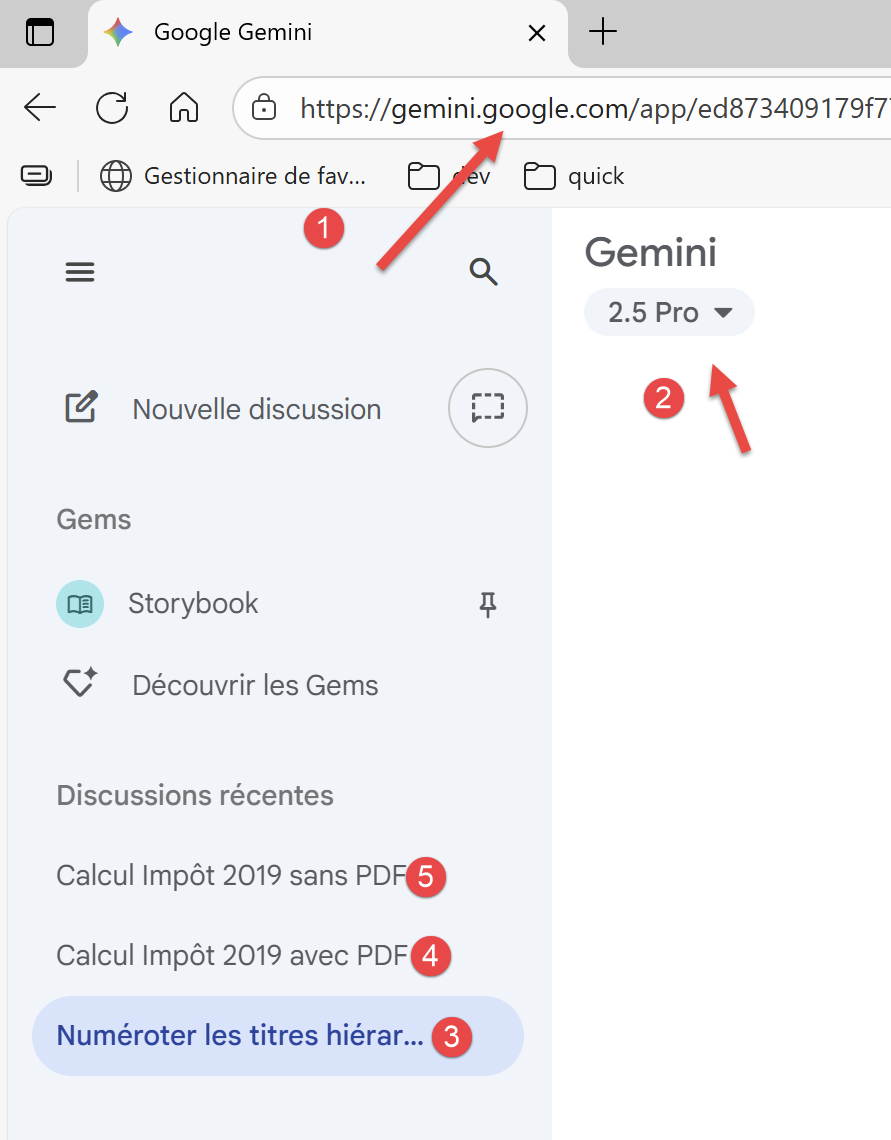

Vamos pedir à IA para estudar três problemas, do mais simples ao mais complexo. Vejamos uma captura de ecrã do Google Gemini:

|

- Em [1], o URL do Gemini;

- Em [2], a versão do Gemini utilizada;

- Em [3-5], os três problemas apresentados ao Gemini;

2.1. Problema 1

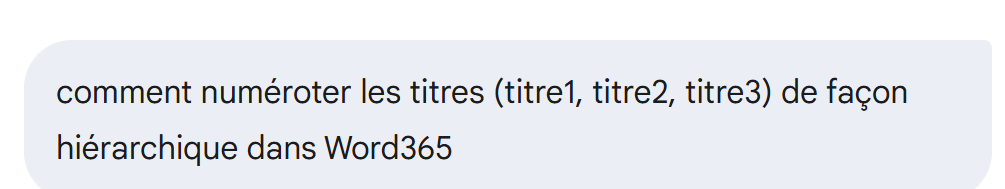

O Problema 1 é uma pergunta simples:

|

Todas as IAs responderão corretamente a esta pergunta.

2.2. Problema 2

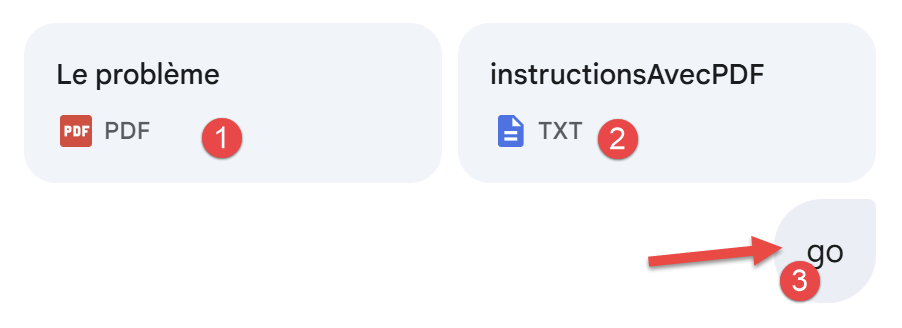

O Problema 2 é o seguinte (captura de ecrã do Gemini):

|

- Em [1], o princípio de cálculo dos impostos de 2019 sobre os rendimentos de 2018 é explicado num PDF. Voltaremos a este assunto;

- Em [2], damos ao Gemini instruções precisas sobre o que queremos: um script Python limpo que resolva o problema e valide a solução proposta com 11 testes unitários;

- Em [3], para executar o Gemini, é necessário escrever algum código;

Este é exatamente o mesmo cenário de um trabalho de laboratório universitário.

As IAs testadas irão resolver o problema, com exceção da MistralAI e da Perplexity.

2.3. Problema 3

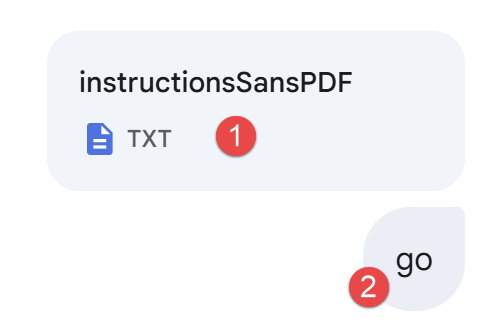

Ainda utilizando uma captura de ecrã do Google Gemini, o Problema 3 é o seguinte:

|

- Em [1], fornecemos as nossas instruções, tal como anteriormente. Mas, uma vez que não fornecemos o PDF com as regras de cálculo exatas, a IA terá de procurar essas regras online;

- Em [3], lançamos a IA;

Apenas três IAs passaram neste teste, por ordem de excelência (opinião estritamente pessoal, claro):

- ChatGPT da OpenAI;

- Grok da xAI;

- Google Gemini;

A IA ClaudeAI falhou no problema 3. A IA MistralAI falhou nos problemas 2 e 3, tal como a IA Perplexity. A IA DeepSeek falhou no problema 3.